lognews.co.id, Sejak kedatangannya di bulan November 2022, teknologi AI seperti chat GPT, yang diinisiasi oleh Elon Musk, negara Amerika Serikat juga mengembangkan AI yang dapat diperuntukan dalam pendeteksian keabsahan konten memisahkan yang asli dan hasil rekayasa.

Dikutip dari RRI, Ketua Dewan Pers menerima keluhan soal akurasi, dramatisasi, dan stigmatisasi atau pelabelan negatif terhadap kelompok tertentu, dan mengingatkan media yang berkewajiban menguji informasi (verifikasi, konfirmasi, serta klarifikasi)

"Hal itu terjadi, karena konten-konten berita yang diunggah atau disiarkan itu tercerabut dari konteks peristiwa. Dan akar permasalahannya, kondisi seperti itu pada umumnya bukan berasal dari hasil liputan langsung/lapangan," kata Ketua Dewan Pers Ninik Rahayu dalam keterangan persnya diterima RRI.co.id, Minggu (15/10/2023).

Melalui bantuan teknologi kecerdasan buatan (Artificial Inteligence/AI) yang kini banyak dikembangkan, mampu melabeli foto asli yang menampilkan visual situasi konflik Israel Palestina sebagai konten palsu.

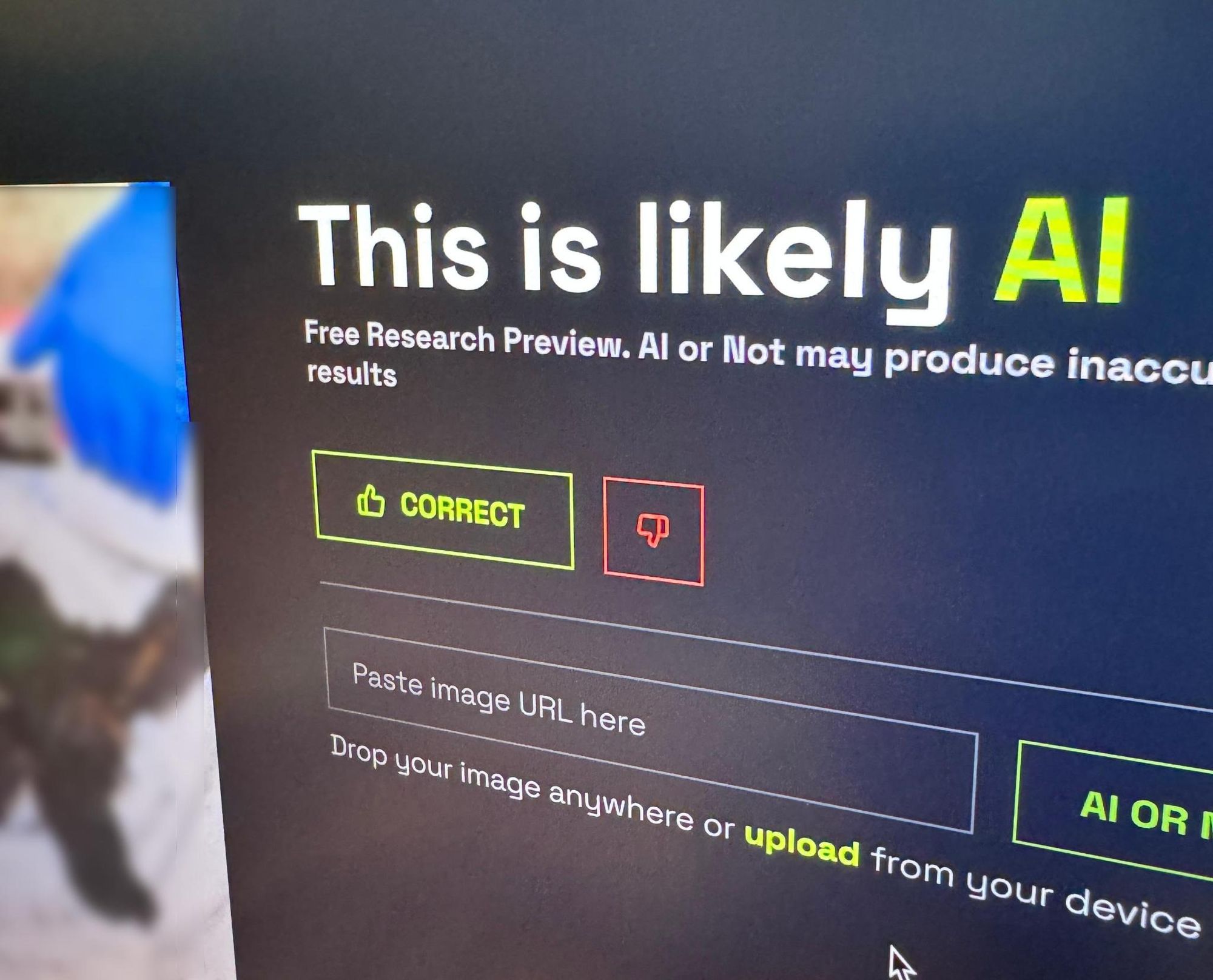

Pelabelan konten palsu dilakukan melalui proses pendeteksian foto berbasis AI geratis di internet misalnya dengan memanfaatkan layanan DALL-E yang juga ciptaan OpenAI mampu memisahkan antara gambar buatan AI dan asli, dan banyak program pendeteksi lainnya, salah satunya 'AI or Not'.

Kantor berita besar seperti The New York Times dan The Wall Street Journals, pernah membahas lebih dalam mengenai perkembangan AI tersebut.

Bersumber dari CNBC Indonesia, Menurut situs 404Media, AI or Not melabeli foto-foto asli perang Hamas-Israel sebagai konten tak akurat, yang mengejutkan nyatanya penampakan penyerangan Hamas ke Israel disebut sebagai konten/visual yang dikumpulkan oleh AI, mendalami foto yang disebut palsu oleh AI or Not mengatakan bahwa tak ada tanda-tanda bahwa foto tersebut palsu.

Detektor gambar AI gratis yang dimuat di New York Times dan Wall Street Journal saat ini mengidentifikasi foto yang menurut Israel adalah mayat seorang bayi yang terbakar dan terbunuh dalam serangan Hamas terhadap Israel baru-baru ini, sebagai foto yang dihasilkan oleh AI. menurut Hany Farid, seorang profesor di UC Berkeley, salah satu pakar manipulasi gambar digital terbaik di dunia, dikutip dari PCMag, Senin (16/10/2023).

Dia mengungkapkan terdapat kelemahan AI yang nampak tidak mampu secara konsisten mempertahankan detail gambar, struktur bentuk dan garis lurus yang mirip foto asli, dan hubungan cahaya dengan bayangannya.

“Jika Anda melihat kaki meja dan sekrupnya, semuanya tampak sempurna dan hal ini biasanya tidak terjadi pada generator AI.”

Selanjutnya Farid mengatakan konsistensi struktural, bayangan yang akurat, kurangnya artefak yang cenderung kita lihat di AI, membuat dirinya percaya bahwa AI tidak dihasilkan sebagian,” ujarnya , dirinya tidak memahami kapan, apa siapa yang mengambilnya sehingga perlu dikonfirmasi lebih mendalam mengenai foto tersebut.

Farid mengingatkan bahwa penting untuk mengetahui fakta, dan mengidentifikasi setiap pemberitaan digambarkannya sebagai caranya untuk membayar makanan yang ia makan, sedangkan alat pendeteksi yang beredar lengkap dengan cara kerjanya belum mampu dijadikan rujukan yang akurat, bahkan alat yang terpercaya 90% sekalipun menunjukan 52% kemungkinan gambar terdeteksi asli sehingga siapapun bisa menggunakan alat tersebut untuk membuat argumen apapun yang mereka inginkan.

“Ini adalah disinformasi tingkat kedua,” kata Farid. “Ada lusinan alat seperti ini di luar sana. Setengahnya mengatakan asli, setengah lagi mengatakan palsu, tidak banyak sinyal di sana.”

Contoh kasus lainnya seperti Foto New York Times, misalnya, tentang seorang jurnalis Palestina yang terbunuh oleh pemboman Israel yang tiada henti di Gaza, ditentukan bahwa 52 persen kemungkinannya adalah palsu oleh alat pendeteksi gambar AI yang dihosting di Huggingface dan digunakan oleh beberapa orang di 4chan. Padahal gambar ini sangat nyata.

Internet dipenuhi dengan alat-alat semacam ini, dan kita tidak tahu bagaimana cara kerjanya, atau apakah alat-alat tersebut akurat. Juga tidak jelas apa yang harus kita ambil dari sistem otomatis yang mengeluarkan angka yang menunjukkan bahwa suatu gambar pada dasarnya kemungkinan besar adalah AI atau bukan. Ketika sistem kotak hitam yang memiliki akurasi terbaik 90 persen menunjukkan bahwa 52 persen kemungkinan gambar adalah buatan, atau 52 persen kemungkinan nyata, siapa pun dapat menggunakan alat tersebut untuk membuat argumen apa pun yang mereka inginkan.

Matthew Brown, pencipta alat pendeteksi gambar AI di Huggingface, mengatakan kepada 404 Media bahwa alatnya awalnya dibuat untuk membantu seniman. Seperti yang juga dia jelaskan di Medium , ini dirancang sebagai bot Reddit untuk menyaring gambar yang kemudian dapat ditinjau oleh moderator untuk membantu mereka menentukan apakah suatu gambar dihasilkan oleh AI. Dia mengatakan bahwa dia tidak akan pernah merekomendasikan 50 persen sebagai ambang batas untuk menandai gambar yang dibuat oleh AI, dan sebaliknya dia akan menerapkan ambang batas 90 atau 95 persen. Seperti Farid, ia juga berpendapat bahwa pengklasifikasian saja tidak cukup. Brown juga ingin mengklarifikasi bahwa, tidak seperti alat pendeteksi gambar AI lainnya, alat ini bersifat open source, sehingga orang dapat memeriksa cara kerjanya jika mereka mau.

“Saya tidak setuju dengan gagasan dasar bahwa hal ini tidak boleh diandalkan begitu saja, bahwa hal ini tidak cukup dapat diandalkan,” kata Brown. “Ini adalah alat penyaringan.” (Amr-untuk Indonesia)